C’è un motivo ben preciso per cui la Fisica è ritenuta essere la “Regina delle scienze“: è una scienza che in quanto tale è fondata sull’esperimento, ma che si legittima soprattutto per via della sua (forse irragionevolmente perfetta) corrispondenza con il mondo delle strutture matematiche.

Nella storia recente, i più grandi avanzamenti nella comprensione della Fisica sono arrivati da veri e propri salti concettuali, necessari per:

- spiegare i dati sperimentali;

- riconciliare visioni diverse dello stesso fenomeno;

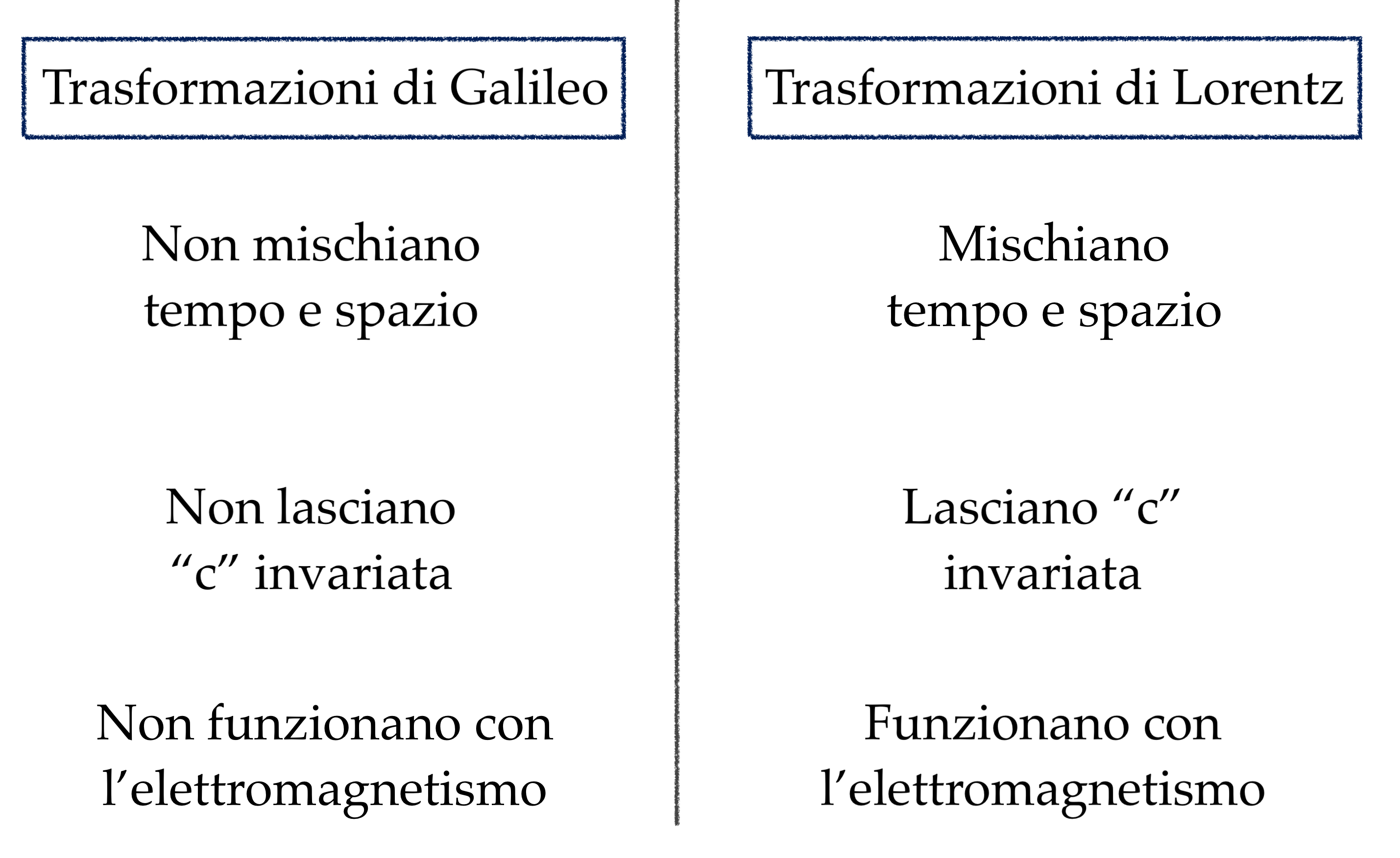

- risolvere delle inconsistenze tra teorie adiacenti (come esempi molto semplici, vedasi Relatività Speciale con Elettromagnetismo di Maxwell, oppure Relatività Ristretta con la Gravitazione di Newton).

Per essere accettati dalla comunità scientifica, tali avanzamenti hanno però dovuto superare delle rigorosissime prove:

- essere matematicamente consistenti;

- essere in grado di spiegare tutto ciò che già si conosce, in maniera più esauriente rispetto alla teoria precedente;

- essere in grado di fornire delle predizioni testabili da esperimenti futuri.

Di nuovo un esempio molto semplice: la Relatività Generale fu in grado di: 1) rendere la Gravitazione classica coerente con la neonata Relatività Ristretta; 2) fornire una spiegazione matematicamente molto elegante e auto-consistente di fenomeni già conosciuti; 3) risolvere il secolare problema della precessione del perielio di Mercurio, la cui entità era impossibile da accordare con i dati sperimentali usando solo la Gravità di Newton; 4) fornire delle predizioni sulla deflessione della luce in un campo gravitazionale, poi verificate da Eddington con il famoso esperimento dell’eclissi di Sole.

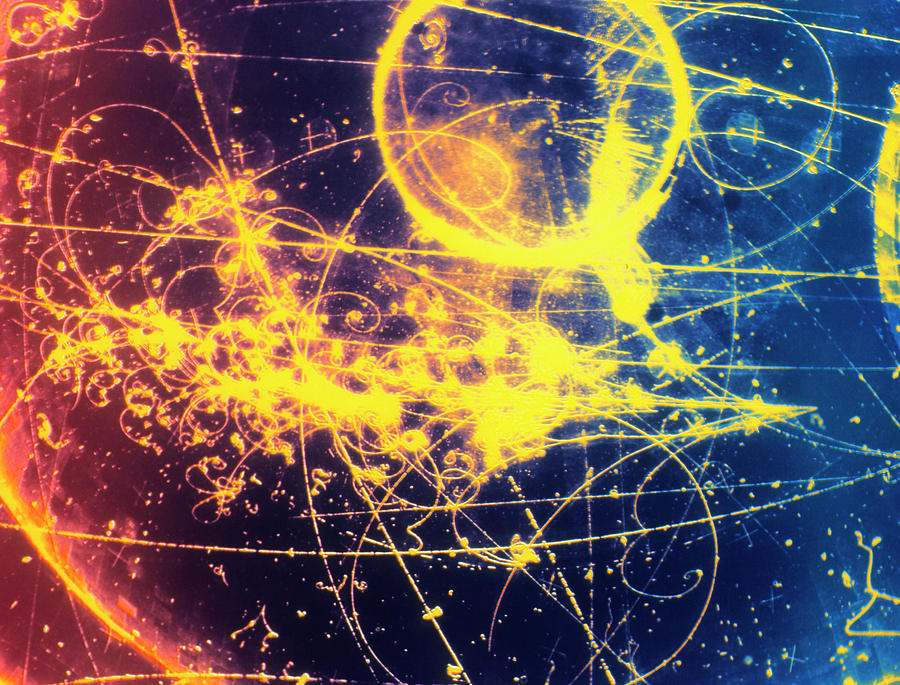

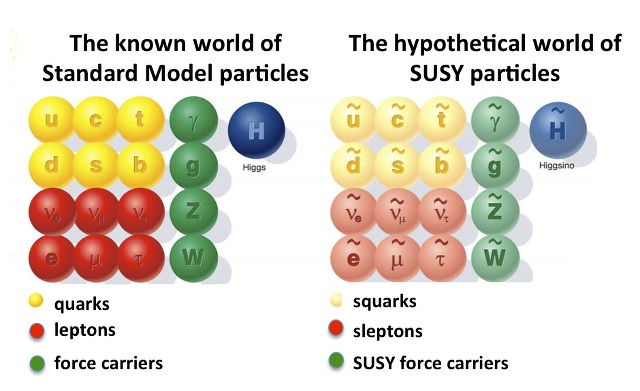

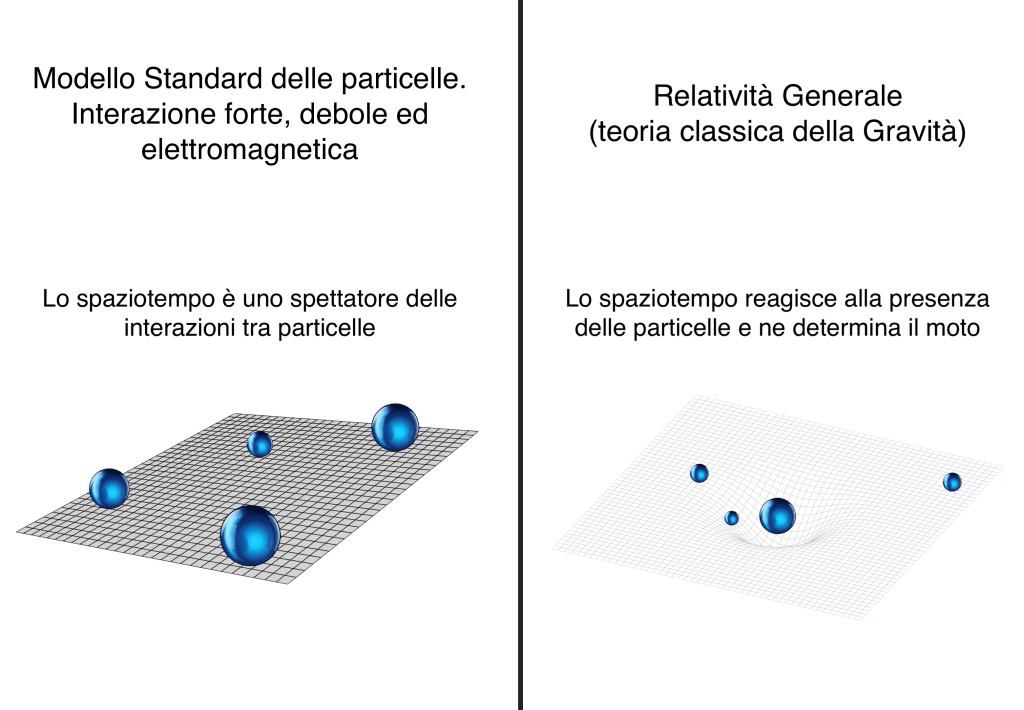

In modo molto analogo a quanto successo in passato, la teoria attuale di cui dispone l’umanità per spiegare il mondo subnucleare delle particelle elementari è il Modello Standard (che da ora chiameremo MS). Il MS rappresenta la teoria concettualmente più avanzata mai creata da Homo Sapiens, ha superato (e continua a superare ogni anno) una gigantesca mole di test sperimentali. Inoltre, la sua eleganza matematica fa da cornice a un vero e proprio capolavoro.

Eppure, già dagli anni ’70 era abbastanza chiaro che il MS non poteva essere la teoria definitiva delle particelle subnucleari. Doveva esserci qualcosa di più. Perché? Tutta una serie di motivi tecnici, dal punto di vista della consistenza matematica. Elenco qui solo alcuni dei problemi del Modello Standard:

- il MS non ha una particella candidata per essere costituente della materia oscura, che rappresenta uno dei più grossi enigmi sperimentali del XXI secolo;

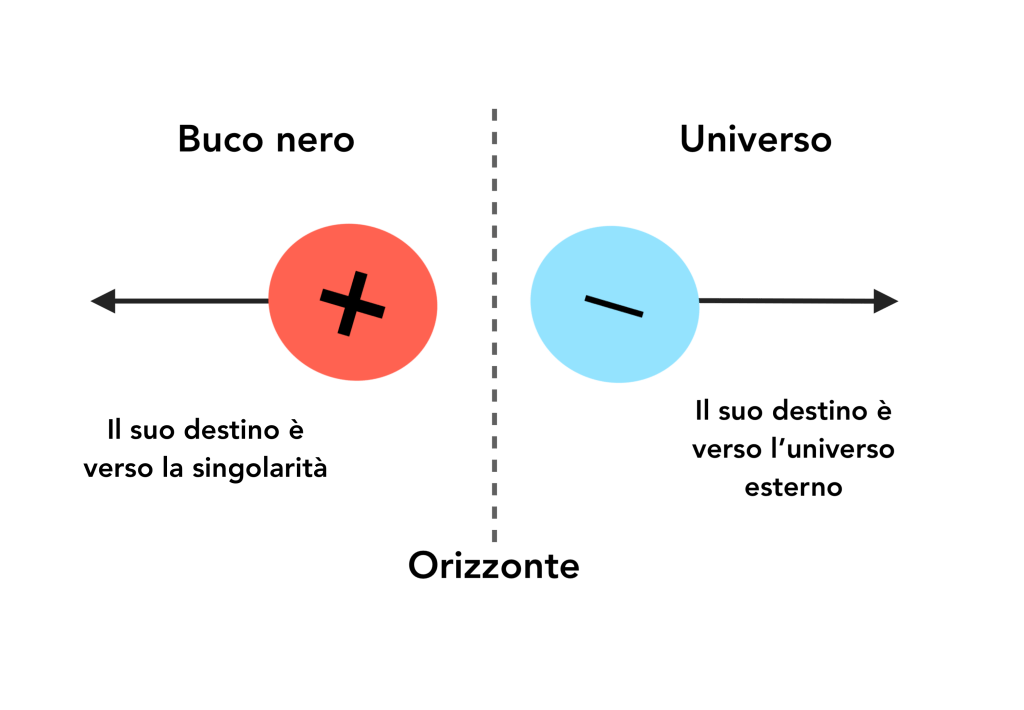

- il MS è ad oggi strutturalmente incompatibile con la Relatività Generale (ne parlo in questo post);

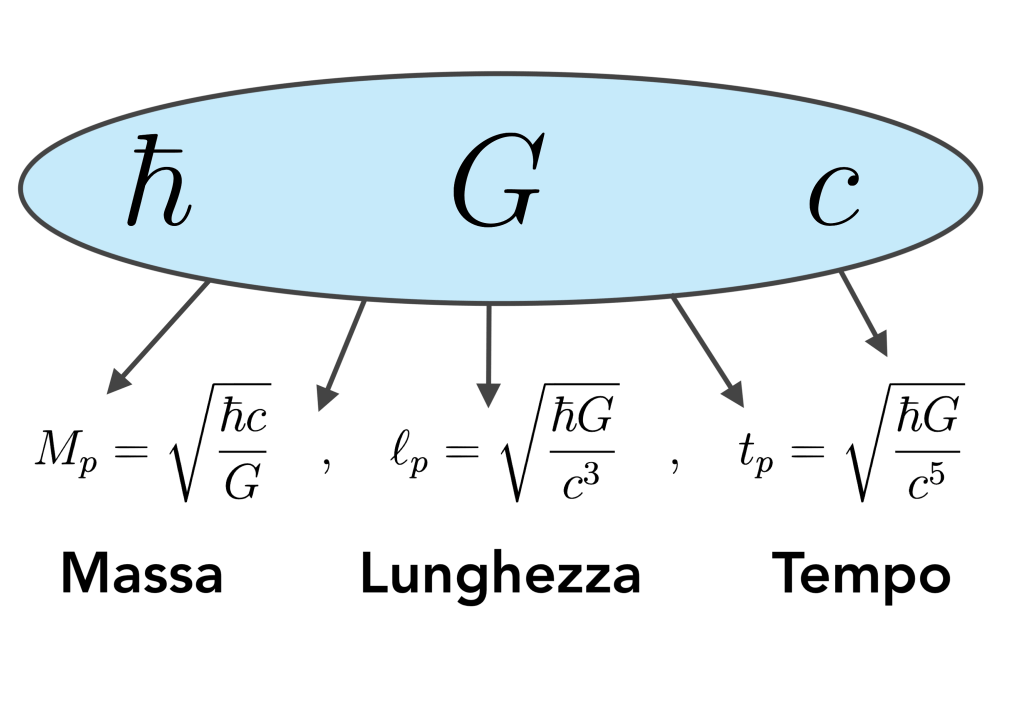

- il MS è per forza di cose una teoria incompleta, dato che ignora ciò che succede a energie più elevate (equivalentemente, è come dire che ignora ciò che succede a distanze vicine alla minuscola lunghezza di Planck). Guarda caso, la scala di Planck è proprio dove iniziano ad essere preponderanti gli effetti gravitazionali a livello quantistico. Questa ignoranza si manifesta nel fatto che nei calcoli compaiono delle divergenze (veri e propri infiniti matematici), da “cancellare” opportunamente in un processo chiamato rinormalizzazione (prima o poi ne parlerò in un futuro post).

- Il MS non è in grado di spiegare in maniera naturale ed elegante cosa stabilizzi la massa dell’Higgs a dispetto dei contributi che derivano dalla Fisica (ad oggi ignota) che si presenta ad energie più elevate. Questo problema è noto come problema della gerarchia (o naturalezza).

Sono state proposte varie teorie più complete del Modello Standard, valide quindi a energie maggiori, le quali prese singolarmente risolvono solo alcuni dei problemi elencati.

Cosa fa di una teoria scientifica la scelta prediletta? Il fatto che la teoria sia capace di spiegare non uno o due, ma tutti i problemi della teoria precedente in un colpo solo, e che sia anche in grado di fornire delle predizioni. Se poi tale teoria presenta una certa eleganza matematica e auto-consistenza, ancora meglio, tutti più felici!

È così che negli anni ’80 entra in scena una “meravigliosa” teoria in grado di dare una soluzione a tutti i problemi elencati , una possibile erede al trono della teoria migliore mai concettualizzata: la Supersimmetria (che da ora chiameremo SUSY).

Il problema della gerarchia, reso semplice

Un problema molto serio del MS è quello della stabilità della massa dell’Higgs, dal momento che viene minata la auto-consistenza della costruzione su cui posa la teoria.

Ricordiamo, per completezza, che rozzamente parlando il ruolo del campo di Higgs è quello di “dare massa” alle altre particelle elementari tramite il meccanismo di Higgs (spiegato in un precedente post).

Ironia della sorte, la massa di cui il campo di Higgs deve preoccuparsi è invece proprio la sua, acquistata sempre tramite il meccanismo di Higgs. Il problema della gerarchia che affligge la sua massa ha origine (come tutte le disavventure della Fisica moderna) proprio dalla natura quantistica delle particelle.

Cosa è, nella pratica, il problema della gerarchia?

Per capirlo, prendiamo un caso semplificato.

Consideriamo un elettrone nel vuoto. Indichiamo con ![]() la sua massa Fisica, cioè misurabile. Se rozzamente pensiamo l’elettrone come una sferetta di carica

la sua massa Fisica, cioè misurabile. Se rozzamente pensiamo l’elettrone come una sferetta di carica ![]() , e di raggio

, e di raggio ![]() , l’energia coulombiana in esso immagazzinata è, dall’elettromagnetismo classico:

, l’energia coulombiana in esso immagazzinata è, dall’elettromagnetismo classico:

![]()

Dalla celebre formula di Einstein, l’energia a riposo dell’elettrone ![]() (e quindi quella che chiamavamo “massa Fisica”

(e quindi quella che chiamavamo “massa Fisica” ![]() ) ha due contributi: sia il contributo elettromagnetico dovuto alla sua carica elettrica, sia il contributo dalla sua massa originale

) ha due contributi: sia il contributo elettromagnetico dovuto alla sua carica elettrica, sia il contributo dalla sua massa originale ![]() :

:

![]()

L’energia a riposo fisica ![]() è conosciuta con precisione dagli esperimenti e vale

è conosciuta con precisione dagli esperimenti e vale ![]() MeV (dove MeV corrisponde a un milione di elettronvolt). Il problema è che la quantità riconducibile a una “nozione di raggio classico” dell’elettrone è dell’ordine di

MeV (dove MeV corrisponde a un milione di elettronvolt). Il problema è che la quantità riconducibile a una “nozione di raggio classico” dell’elettrone è dell’ordine di ![]() centimetri. Se uno calcola

centimetri. Se uno calcola ![]() inserendo questi numeri ottiene:

inserendo questi numeri ottiene:

![]()

Dunque, l’unico modo che abbiamo per ottenere ![]() MeV è che avvenga una delicatissima cancellazione tra

MeV è che avvenga una delicatissima cancellazione tra ![]() (il cui segno non è noto a priori, dato che è una quantità non fisica) e

(il cui segno non è noto a priori, dato che è una quantità non fisica) e ![]() . Ad esempio:

. Ad esempio:

![]()

e questo aspetto viene chiamato “fine-tuning” in inglese, traducibile con “regolazione accurata”. Uno deve necessarimente supporre che ![]() cancelli, fino alla terza cifra decimale, il contributo dominante di

cancelli, fino alla terza cifra decimale, il contributo dominante di ![]() . Dal punto di vista della teoria è un aspetto indigesto: cosa porta

. Dal punto di vista della teoria è un aspetto indigesto: cosa porta ![]() ad essere così numericamente vicino a

ad essere così numericamente vicino a ![]() , e con il segno scelto in tal modo?

, e con il segno scelto in tal modo?

Infatti abbiamo sbagliato assunzione: abbiamo presupposto di conoscere la Fisica fino a una scala piccola quanto ![]() centimetri. Tuttavia, ben prima di quella scala intervengono fenomeni di natura quantistica: il vuoto non è davvero vuoto, ma è un proliferare di coppie virtuali di particella-antiparticella, ovvero elettroni

centimetri. Tuttavia, ben prima di quella scala intervengono fenomeni di natura quantistica: il vuoto non è davvero vuoto, ma è un proliferare di coppie virtuali di particella-antiparticella, ovvero elettroni ![]() con carica negativa e positroni

con carica negativa e positroni ![]() con carica positiva, creati assieme a fotoni virtuali

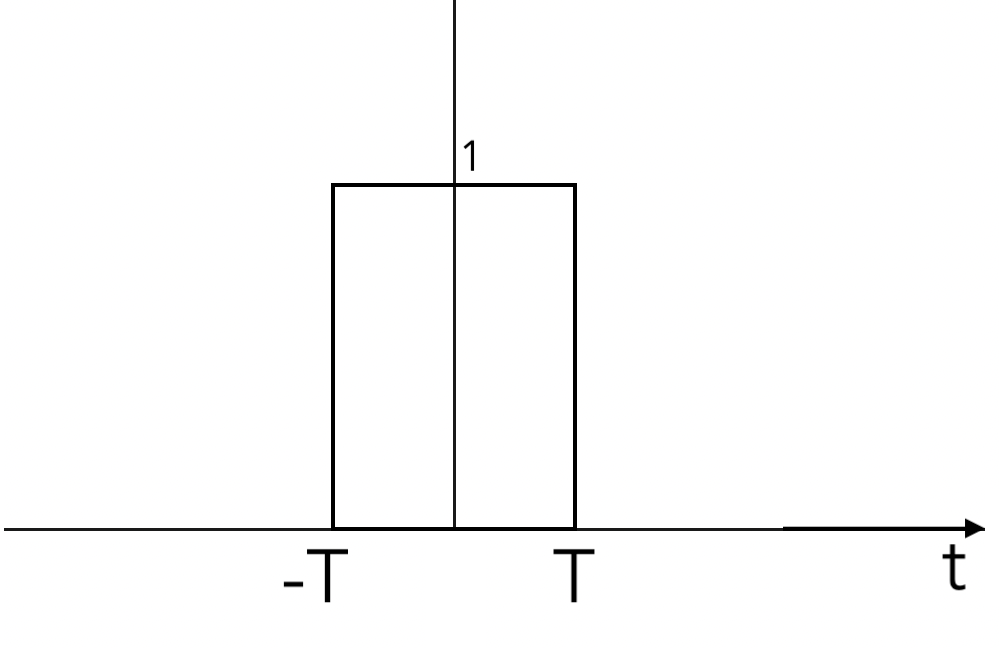

con carica positiva, creati assieme a fotoni virtuali ![]() (mediatori dell’interazione elettromagnetica). Questi processi virtuali di natura quantistica violano la conservazione dell’energia di una quantità

(mediatori dell’interazione elettromagnetica). Questi processi virtuali di natura quantistica violano la conservazione dell’energia di una quantità ![]() per un tempo

per un tempo ![]() in modo da rispettare il principio di Heisenberg:

in modo da rispettare il principio di Heisenberg:

![]()

dove ![]() e

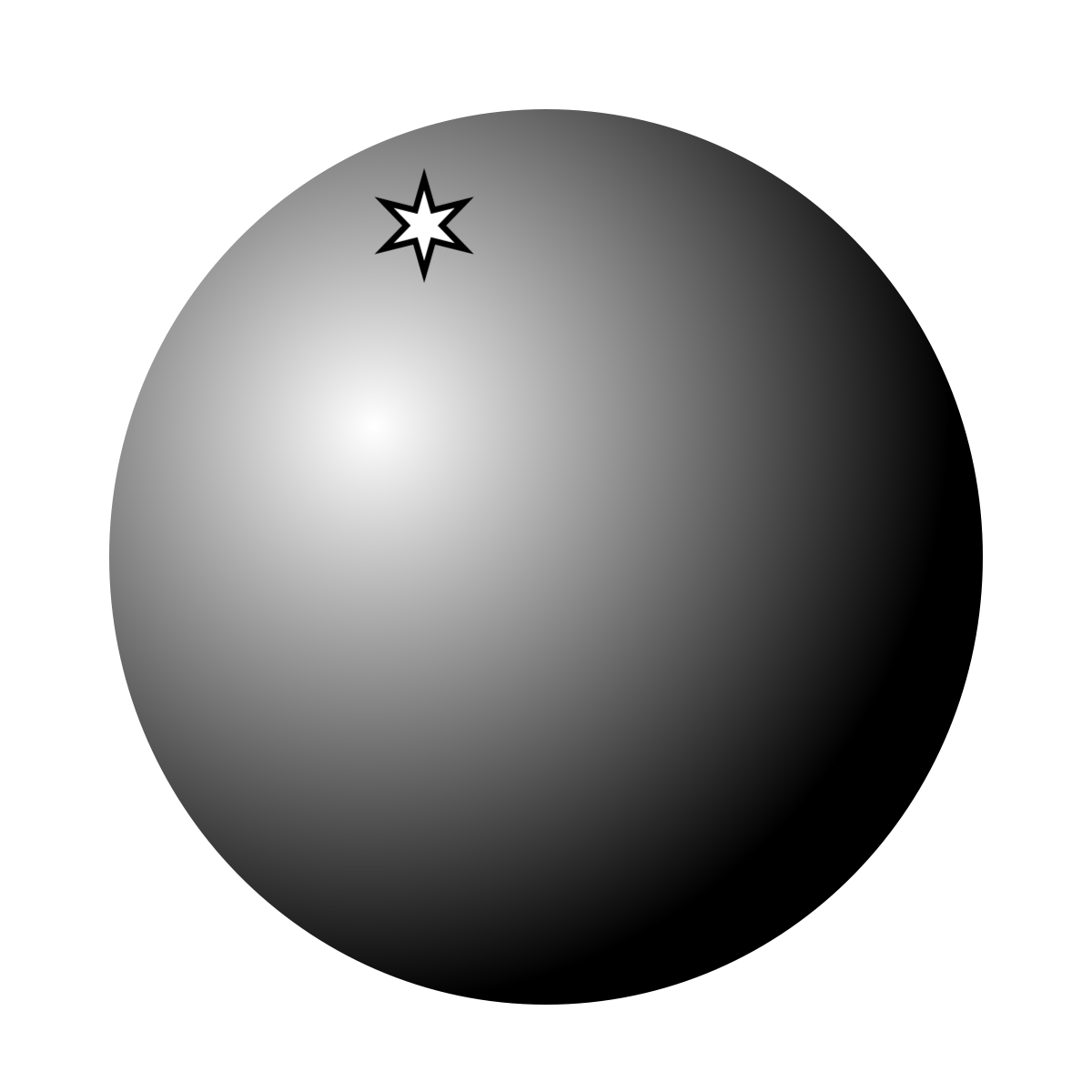

e ![]() è la celebre costante di Planck. Qual è la conseguenza di questi effetti quantistici? È molto complicato da descrivere a parole, dato che si tratta di calcoli puramente matematici. Un modo per interpretare ciò che succede è quello di immaginare che mediamente l’elettrone originale attiri verso di sé i positroni virtuali (elettroni di carica opposta), ed allontani gli elettroni virtuali (di carica uguale). L’effetto è che la carica elettrica dell’elettrone originale è ora distribuita in un volume di spazio che è maggiore di quello supposto all’inizio, limitato al raggio

è la celebre costante di Planck. Qual è la conseguenza di questi effetti quantistici? È molto complicato da descrivere a parole, dato che si tratta di calcoli puramente matematici. Un modo per interpretare ciò che succede è quello di immaginare che mediamente l’elettrone originale attiri verso di sé i positroni virtuali (elettroni di carica opposta), ed allontani gli elettroni virtuali (di carica uguale). L’effetto è che la carica elettrica dell’elettrone originale è ora distribuita in un volume di spazio che è maggiore di quello supposto all’inizio, limitato al raggio ![]() .

.

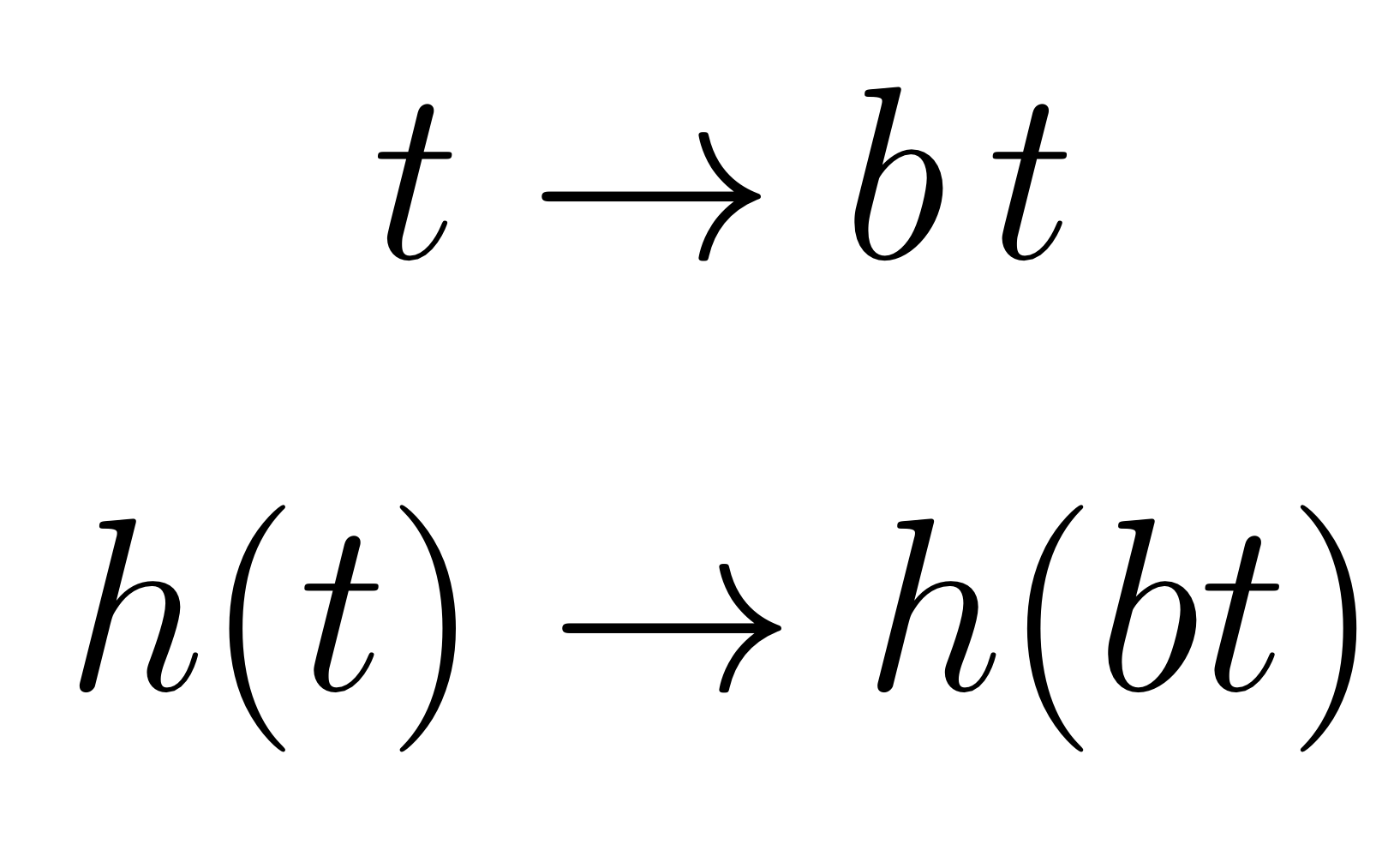

Quindi, in realtà, il contributo elettromagnetico dell’elettrone alla sua stessa massa è molto più piccolo di quello che si poteva immaginare senza tenere in conto gli effetti quantistici, la correzione reale è:

![]()

dove ![]() indica dei fattori numerici che non ci interessano, e

indica dei fattori numerici che non ci interessano, e ![]() è la costante di struttura fine (pari a circa

è la costante di struttura fine (pari a circa ![]() ). Dunque non c’è un problema di “fine-tuning” per l’elettrone, il vero contributo dall’elettromagnetismo non va come

). Dunque non c’è un problema di “fine-tuning” per l’elettrone, il vero contributo dall’elettromagnetismo non va come ![]() , ma molto più lentamente come

, ma molto più lentamente come ![]() (i logaritmi sono funzioni a crescita lentissima, come avrai sentito in giro). Dunque qualsiasi sia la “nuova Fisica” a scale di lunghezza

(i logaritmi sono funzioni a crescita lentissima, come avrai sentito in giro). Dunque qualsiasi sia la “nuova Fisica” a scale di lunghezza ![]() piccolissime, il contributo alla “massa Fisica” dell’elettrone da parte di questa “nuova Fisica” sarà sempre molto soppresso. La massa dell’elettrone è quindi protetta.

piccolissime, il contributo alla “massa Fisica” dell’elettrone da parte di questa “nuova Fisica” sarà sempre molto soppresso. La massa dell’elettrone è quindi protetta.

Vediamo infatti che tutte le correzioni alla massa dell’elettrone sono proporzionali alla sua massa originale ![]() : ciò significa che se l’elettrone non avesse avuto massa fin dall’inizio (

: ciò significa che se l’elettrone non avesse avuto massa fin dall’inizio (![]() ), non sarebbe stato sensibile a nessuna correzione.

), non sarebbe stato sensibile a nessuna correzione.

Ciò non è un caso: nel limite ![]() la teoria che descrive l’elettrone gode di una simmetria particolare, chiamata simmetria chirale. La simmetria chirale impone dei vincoli molto severi sui contributi di correzione alla massa dell’elettrone. Questi vincoli persistono anche se, come sappiamo dall’esperimento,

la teoria che descrive l’elettrone gode di una simmetria particolare, chiamata simmetria chirale. La simmetria chirale impone dei vincoli molto severi sui contributi di correzione alla massa dell’elettrone. Questi vincoli persistono anche se, come sappiamo dall’esperimento, ![]() , per cui si può dire che la simmetria chirale protegge la massa dell’elettrone dagli effetti di nuova Fisica.

, per cui si può dire che la simmetria chirale protegge la massa dell’elettrone dagli effetti di nuova Fisica.

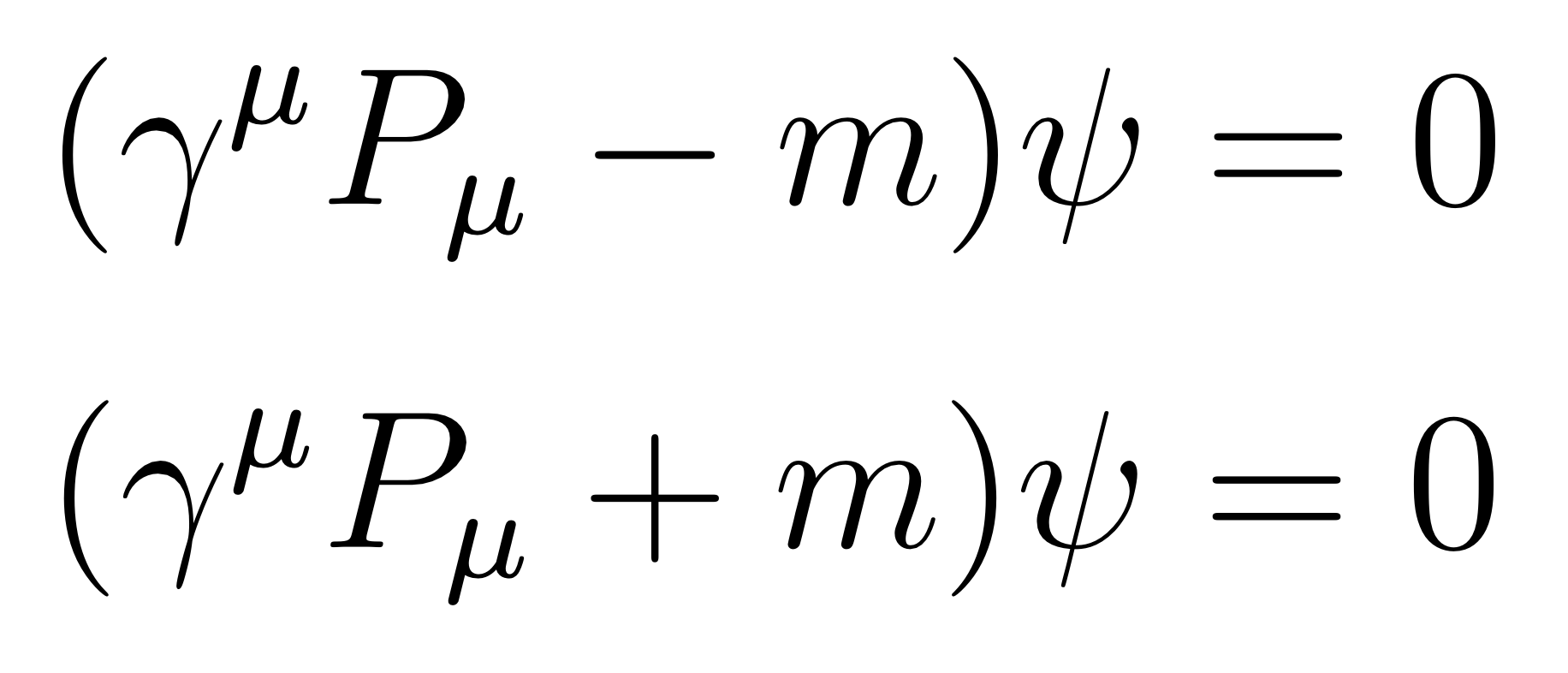

Notare che per risolvere il problema del fine-tuning del campo elettronico è stato necessario raddoppiare il numero di possibili particelle nell’Universo, introducendo l’antimateria (qui un post in cui parlo dell’origine relativistico del concetto di antimateria).

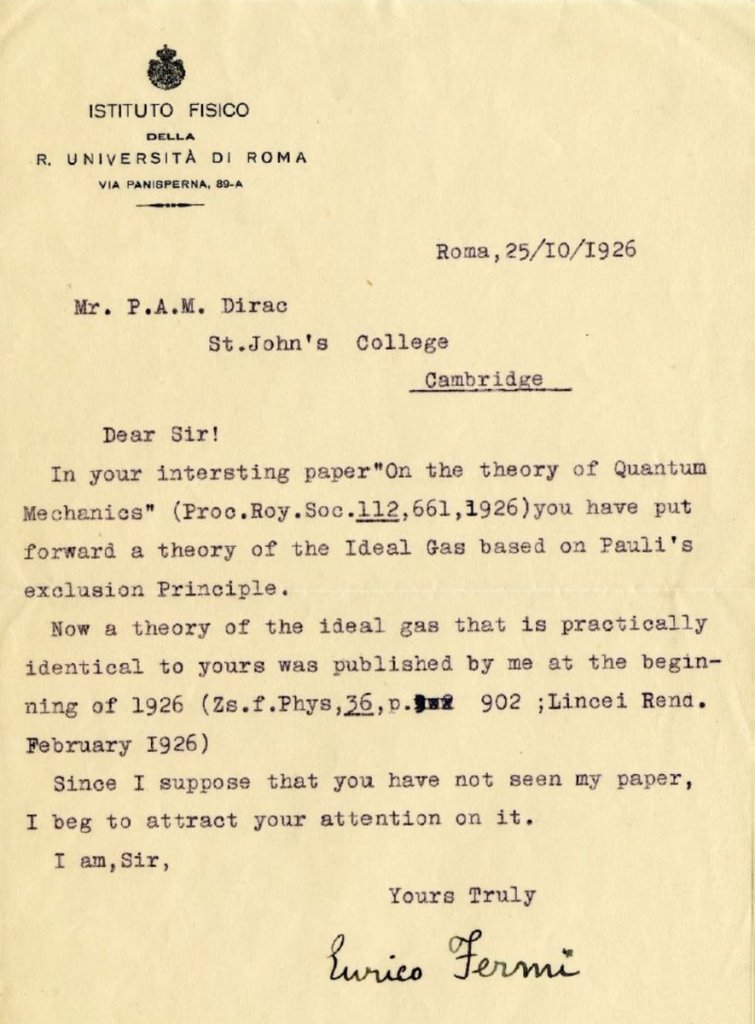

Il campo di Higgs è afflitto da un problema molto simile: riceve contributi quantistici da scale di energia che fanno parte di una Fisica che ancora non conosciamo. Tuttavia, a differenza dell’elettrone che è un campo a spin ![]() (cioè un fermione, in onore di Enrico Fermi), l’Higgs ha spin

(cioè un fermione, in onore di Enrico Fermi), l’Higgs ha spin ![]() (in gergo, un bosone di spin 0, cioè una particella scalare).

(in gergo, un bosone di spin 0, cioè una particella scalare).

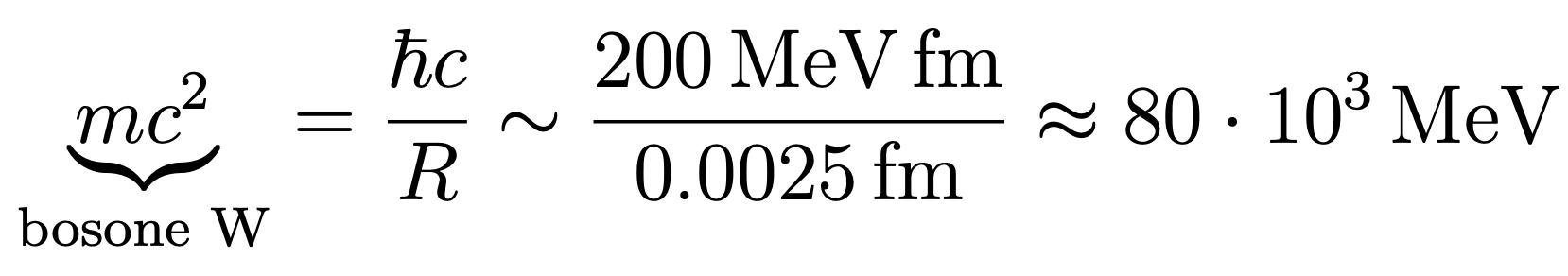

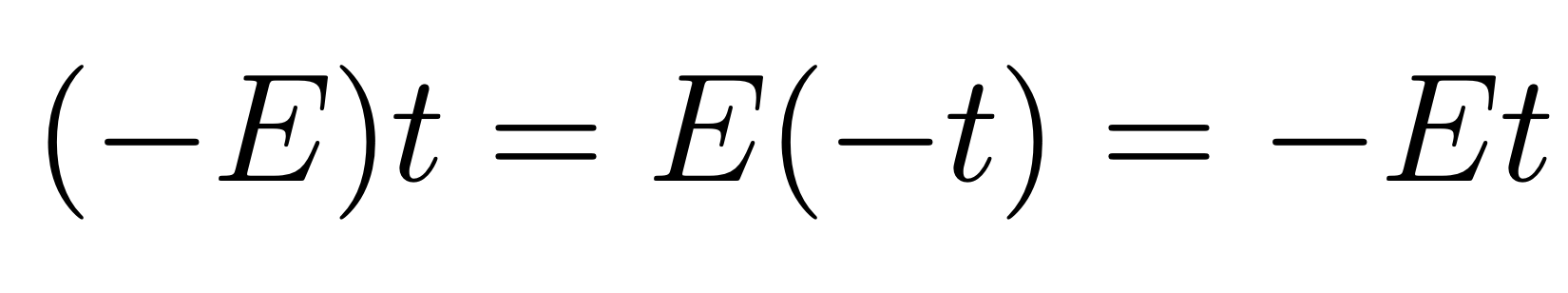

Bosoni e fermioni, nel MS, si comportano in maniera molto diversa. In particolare, l’Higgs (che è l’unico campo scalare del MS) non gode di nessuna simmetria in grado di proteggerlo dai contributi di Fisica delle alte energie. L’Higgs potrebbe accoppiarsi con gli altri fermioni e bosoni con dinamiche ad energie molto più alte di quelle ad oggi accessibili con gli attuali acceleratori. Ciò significa che la sua massa verrebbe quantisticamente corretta fino a contributi energetici pari alla scala di Planck ![]() GeV (un GeV sono un miliardo di elettronvolt). Se

GeV (un GeV sono un miliardo di elettronvolt). Se ![]() è la sua massa fisica e

è la sua massa fisica e ![]() la sua massa non fisica, si ha:

la sua massa non fisica, si ha:

![]()

Ancora prima di scoprire il bosone di Higgs nel 2012, sapevamo già che la sua massa sarebbe dovuta essere intorno alla scala in cui si rompe la simmetria elettrodebole, cioè sui ![]() GeV. Ora vediamo che affinché

GeV. Ora vediamo che affinché ![]() sia dell’ordine di

sia dell’ordine di ![]() GeV, dobbiamo avere che

GeV, dobbiamo avere che ![]() cancella delicatamente la maggior parte di

cancella delicatamente la maggior parte di ![]() , ma non esattamente! Stiamo parlando di un fine-tuning sulla quindicesima cifra decimale.

, ma non esattamente! Stiamo parlando di un fine-tuning sulla quindicesima cifra decimale.

Per quale accidenti di motivo ![]() ha un valore praticamente ad-hoc in grado di cancellare il contributo quantistico delle alte energie? Uno può dormire sonni tranquilli anche con questa idea in mente, ma non i fisici teorici.

ha un valore praticamente ad-hoc in grado di cancellare il contributo quantistico delle alte energie? Uno può dormire sonni tranquilli anche con questa idea in mente, ma non i fisici teorici.

Come per l’elettrone, una possibile spiegazione è quella di ammettere di aver presupposto di conoscere la Fisica delle alte energie. Nell’elettromagnetismo classico non era previsto il concetto di anti-materia, concetto che ha risolto parecchi problemi fondamentali.

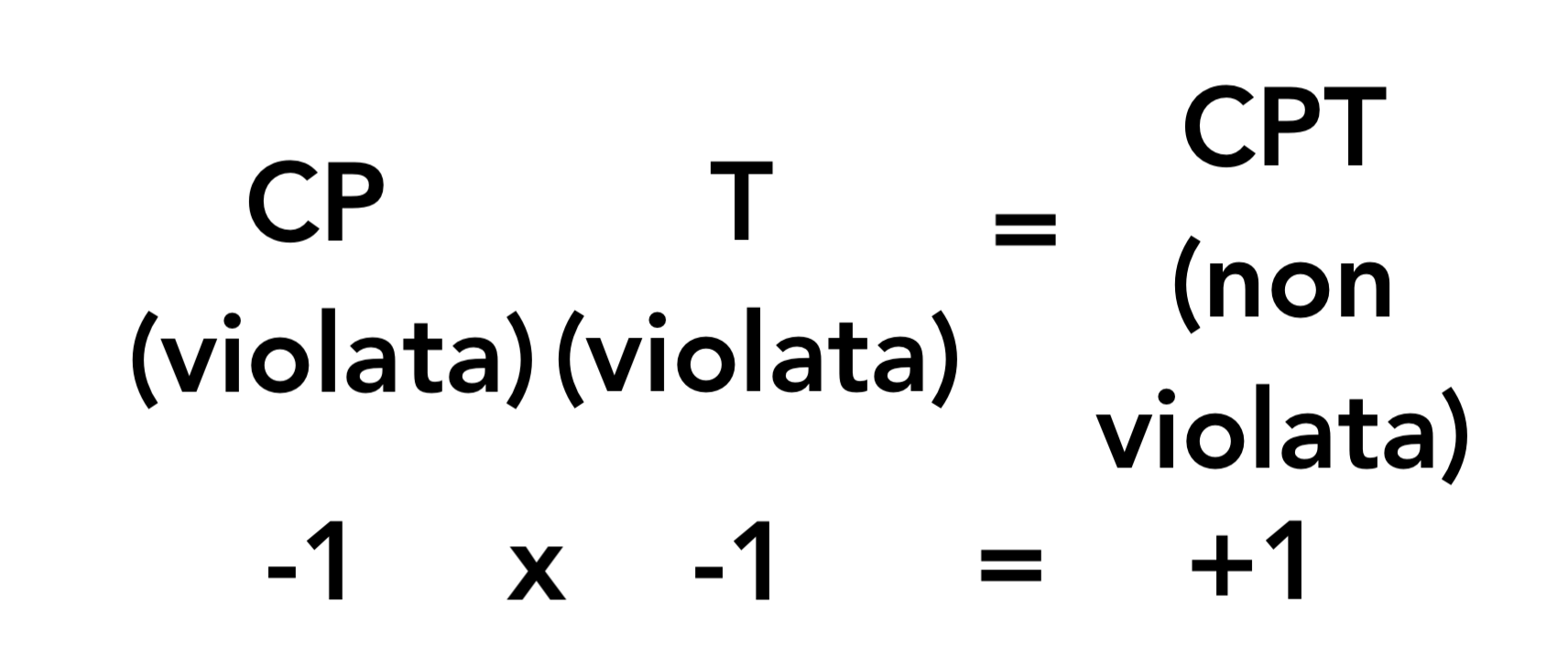

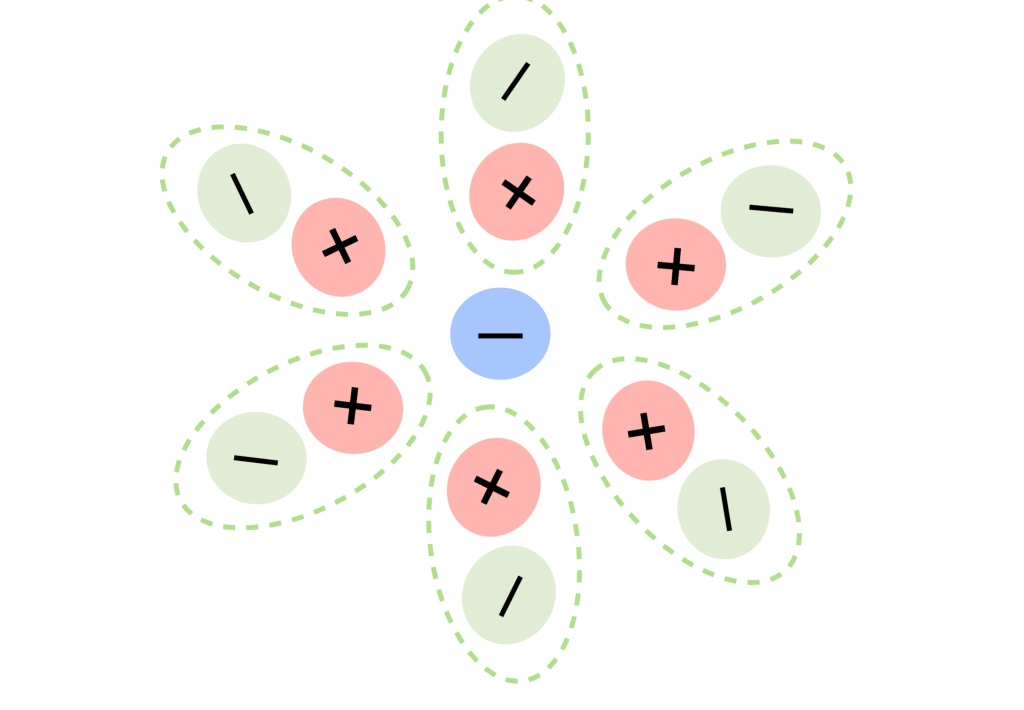

Anche in questo caso potrebbe succedere qualcosa di molto simile. Si dà il caso che i contributi quantistici di fermioni e bosoni hanno segno opposto, per via delle loro proprietà fisiche differenti.

Alle alte energie è possibile che i contributi quantistici degli accoppiamenti dell’Higgs coi fermioni possa cancellarsi esattamente con i contributi degli accoppiamenti dell’Higgs con dei bosoni. Questa cancellazione avviene però solo nel caso in cui tali bosoni hanno massa e numeri quantici uguali a quelli dei fermioni.

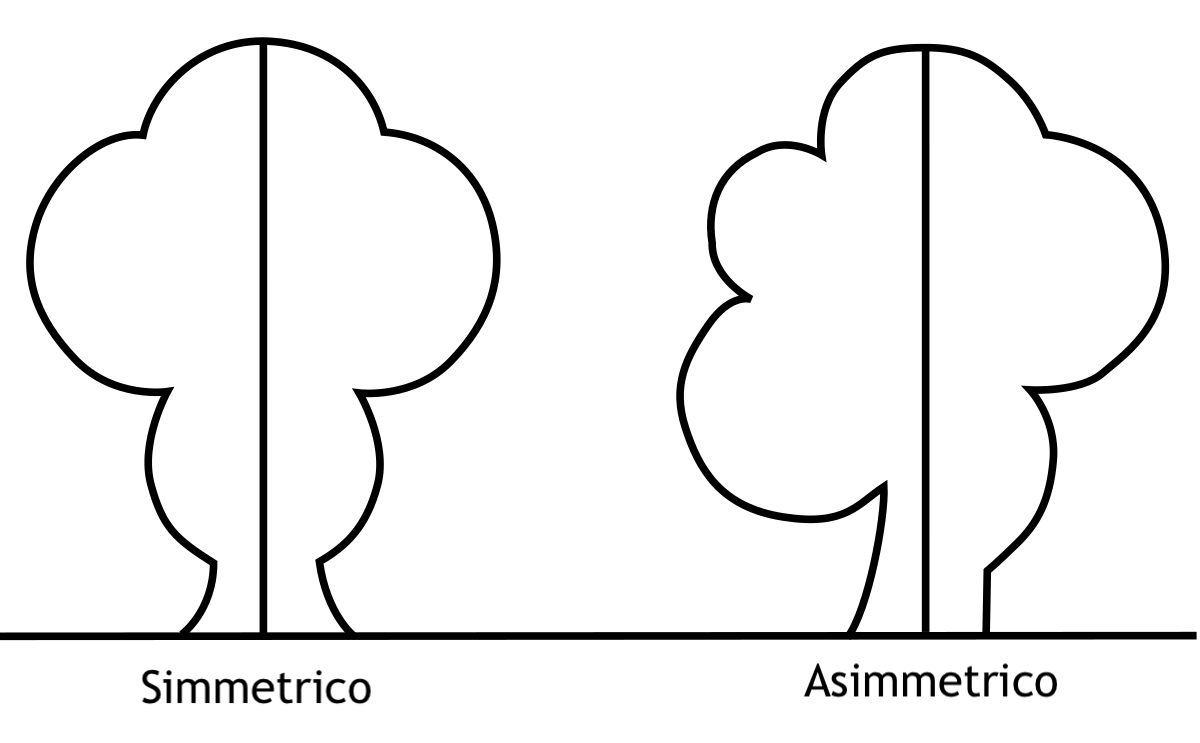

Ecco fatto: raddoppiamo il numero di particelle esistenti e il problema è risolto. Ogni fermione ha il suo partner bosonico di uguale massa e numeri quantici, e viceversa. La supersimmetria è esattamente una simmetria tra fermioni e bosoni. Un elettrone di massa ![]() MeV ha un suo superpartner chiamato s-elettrone, di spin

MeV ha un suo superpartner chiamato s-elettrone, di spin ![]() , carica elettrica negativa e massa

, carica elettrica negativa e massa ![]() MeV. Anche il campo di Higgs ha un suo superpartner fermionico di spin

MeV. Anche il campo di Higgs ha un suo superpartner fermionico di spin ![]() , avente la massa dell’Higgs. E così via.

, avente la massa dell’Higgs. E così via.

La soluzione SUSY

La SUSY non risolve solo il problema della stabilità quantistica della massa dell’Higgs. Come ogni buona teoria scientifica, fornisce un certo numero di soluzioni ad altri problemi concettuali o fenomenologici.

1) Con solo alcune ipotesi aggiuntive, la SUSY ha una particella candidata naturale per la materia oscura: una particella elettricamente neutra a cui è proibito decadere in altre particelle, dunque assolutamente stabile e poco interagente. Questa particella può essere proprio un superpartner di una particella già esistente.

2) La SUSY prevede che le costanti di interazione delle tre forze fondamentali del MS (forza forte, debole, ed elettromagnetica) vengano unificate a una scala di energia di ![]() GeV.

GeV.

3) La SUSY è un concetto che sorge con estrema naturalezza logica nelle teorie che aspirano ad unificare gravità e meccanica quantistica, come la teoria delle stringhe.

Come coronamento, la struttura matematica della SUSY è molto elegante e fornisce nuovi punti di vista anche sulle teorie precedenti. In un certo numero di casi, la matematica della SUSY semplifica alcuni calcoli e velocizza l’intepretazione concettuale di quello che si sta indagando. Non capita di rado che la SUSY venga utilizzata anche in teorie che della SUSY potrebbero fare a meno, solo per avere “in prestito” il suo apparato matematico.

Il desolante deserto

Sappiamo bene che l’anti-materia esiste. L’ abbiamo scoperta quasi un secolo fa. Ad oggi, tuttavia, non possiamo dire che la SUSY esista. Non basta risolvere tutti quei problemi per essere una teoria scientifica. Nessuno ha mai visto una particella scalare avente la massa dell’elettrone. L’elettrone è un fermione e si comporta inequivocabilmente come un fermione. Nessuno ha mai visto una particella super-simmetrica. Nonostante quasi 30 anni di ricerche, la SUSY non è mai stata rilevata.

Che male c’è? È evidente che la SUSY debba essere una simmetria rotta alle basse energie: le particelle supersimmetriche, dopo la rottura della SUSY, hanno assunto una massa molto più elevata dei loro partner che studiamo quotidianamente. Il s-elettrone avrà una massa migliaia e migliaia di volte più grande di quella dell’elettrone. L’importante è che alle alte energie la simmetria venga ripristinata: bosoni e fermioni con uguale massa e numeri quantici.

Tuttavia la SUSY ha finora fallito tutti i test sperimentali anche nell’ipotesi di essere una simmetria rotta: ci si aspettava di vederne qualche traccia già al Large Hadron Collider (LHC) del CERN. Se i superpartner pesanti sono davvero così pesanti, avremmo dovuto vedere almeno il più leggero già ad LHC.

Questo rappresenta potenzialmente un desolante deserto per la Fisica delle particelle. La SUSY funziona concettualmente, ma alla fine apre più problemi di quanti ne risolve. Non ha alcun riscontro sperimentale.

Per quanto possa essere ritenuta meravigliosa, e per quanto soddisfi tutti i criteri di un’ottima teoria scientifica, la SUSY rappresenta forse il primo vero clamoroso passo falso di una meravigliosa tradizione di inquisizione scientifica, che è la Fisica teorica delle particelle.

Naturalmente, basterebbe anche un solo segnale positivo da Ginevra per ribaltare completamente il risultato. Se non oggi, tra 10 anni. Se non tra 10, tra qualche secolo. La Natura non ha fretta, e tu?

PS. ho scritto un libro di testo che rappresenta proprio ciò che avrei desiderato leggere all’inizio dei miei studi di Fisica teorica, per renderla accessibile agli amatori e insegnare le tecniche matematiche necessarie a una sua comprensione universitaria. Si chiama “L’apprendista teorico” , dai un’occhiata per vedere di cosa si tratta. Il libro è acquistabile su Amazon.

![Rendered by QuickLaTeX.com \[P_N(n_1=N)=\underbrace{\frac{N!}{N!}}_1\times \left(\frac{1}{2}\right)^N\left(\frac{1}{2}\right)^0=\]](https://cinturadiorione.com/wp-content/ql-cache/quicklatex.com-7138fdb7248d31f97a1551d8c6dbe81f_l3.png)

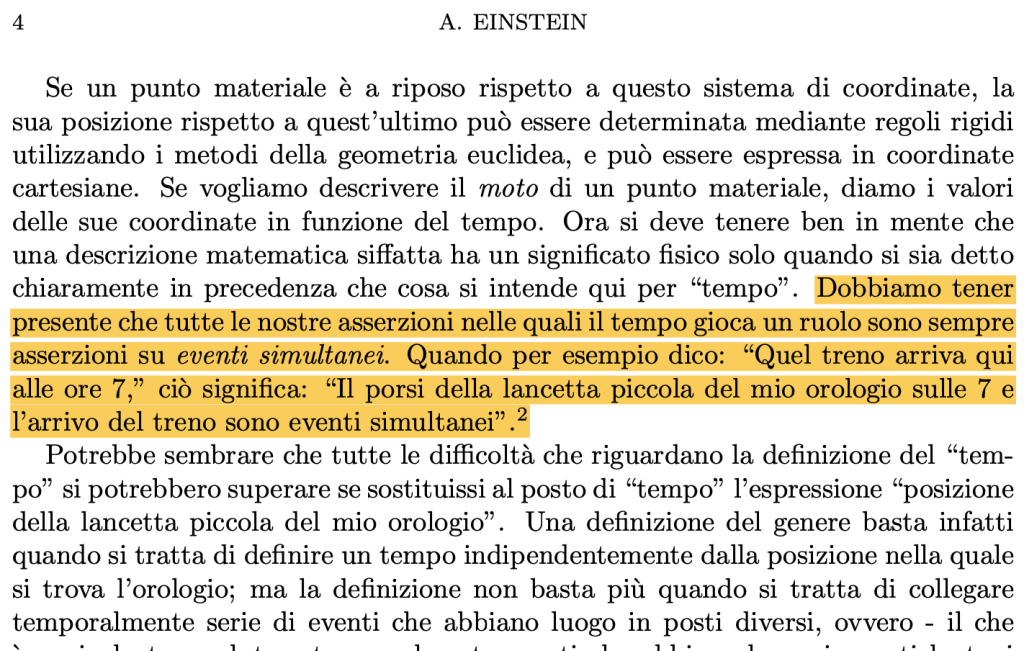

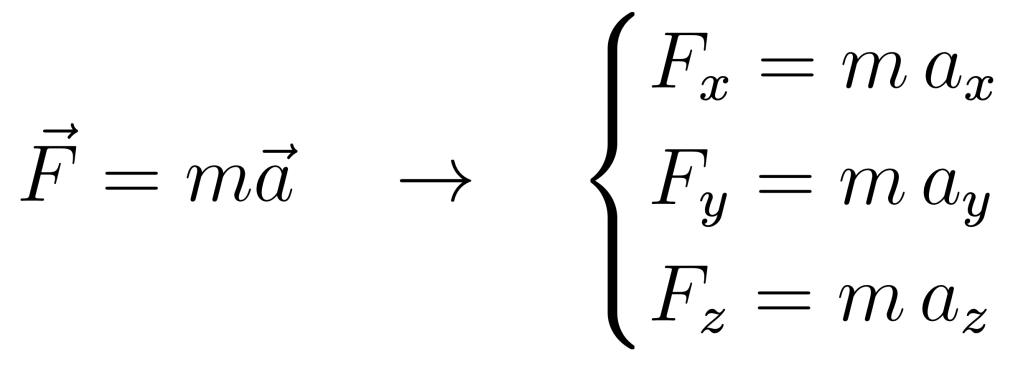

sta a significare “come varia la variazione della metrica”? Allo stesso modo in cui l’accelerazione ci dice come varia la variazione della posizione (cioè come varia la velocità).

sta a significare “come varia la variazione della metrica”? Allo stesso modo in cui l’accelerazione ci dice come varia la variazione della posizione (cioè come varia la velocità).

, mentre

, mentre  è una semplice costante matematica. D’altra parte

è una semplice costante matematica. D’altra parte  e

e  sono la velocità della luce e la costante di gravitazione universale di Newton, rispettivamente.

sono la velocità della luce e la costante di gravitazione universale di Newton, rispettivamente.

è un indice che scorre tra i valori

è un indice che scorre tra i valori  .

.

è la costante elettrica di Coulomb, mentre

è la costante elettrica di Coulomb, mentre

,

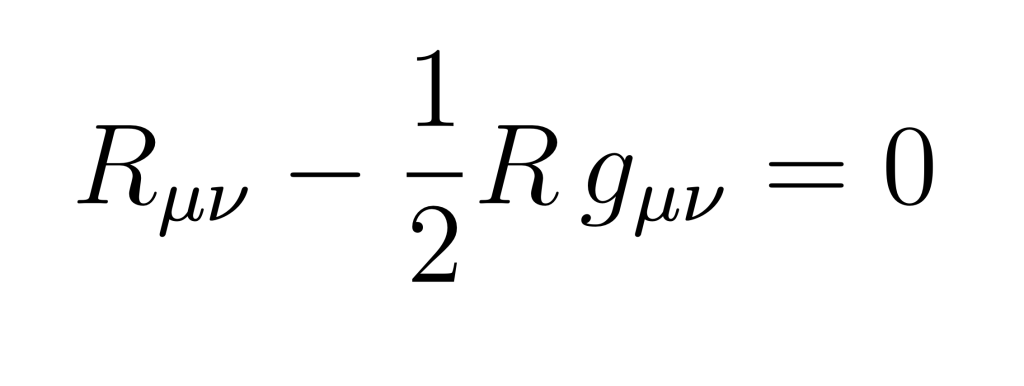

,  e

e  sono quantità con cui descriviamo la geometria dello spaziotempo. Invece

sono quantità con cui descriviamo la geometria dello spaziotempo. Invece

è la massa del muone,

è la massa del muone,  è il suo tempo di decadimento a riposo, pari a circa 2 microsecondi.

è il suo tempo di decadimento a riposo, pari a circa 2 microsecondi.

, Marroncino:

, Marroncino:  , Grigio:

, Grigio:  .

.

.

.

si è più sensibili per rivelare un’oscillazione da

si è più sensibili per rivelare un’oscillazione da  .

.

.

.

(chiamata costante di Yukawa), maggiore è la massa acquistata dalla particella per via del campo di Higgs.

(chiamata costante di Yukawa), maggiore è la massa acquistata dalla particella per via del campo di Higgs.

. Immagina che l’asse

. Immagina che l’asse

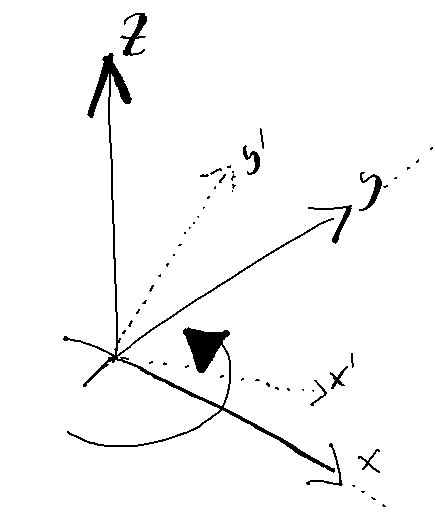

. In gergo si parla di “trasformazioni di gauge”.

. In gergo si parla di “trasformazioni di gauge”.

è la costante di Planck divisa per

è la costante di Planck divisa per  .

.

viene trasformato in se stesso dalla rotazione attorno all’asse

viene trasformato in se stesso dalla rotazione attorno all’asse

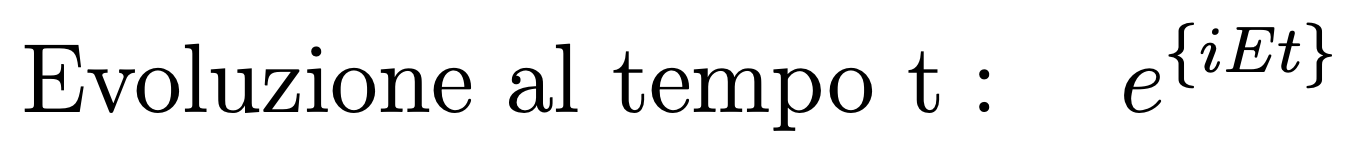

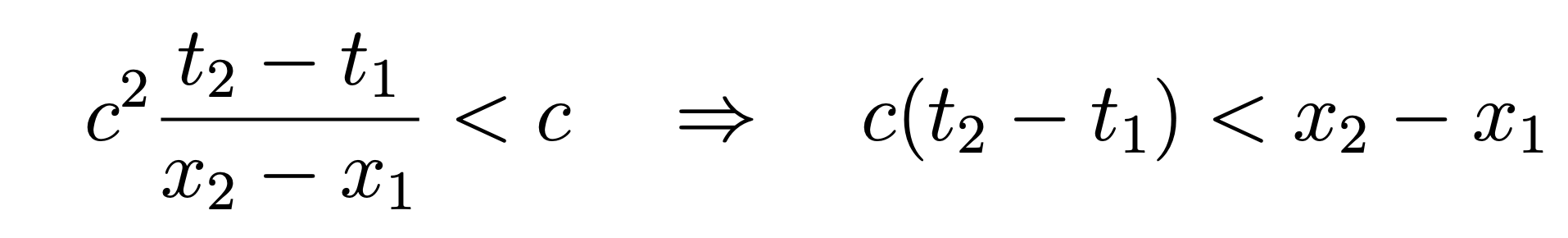

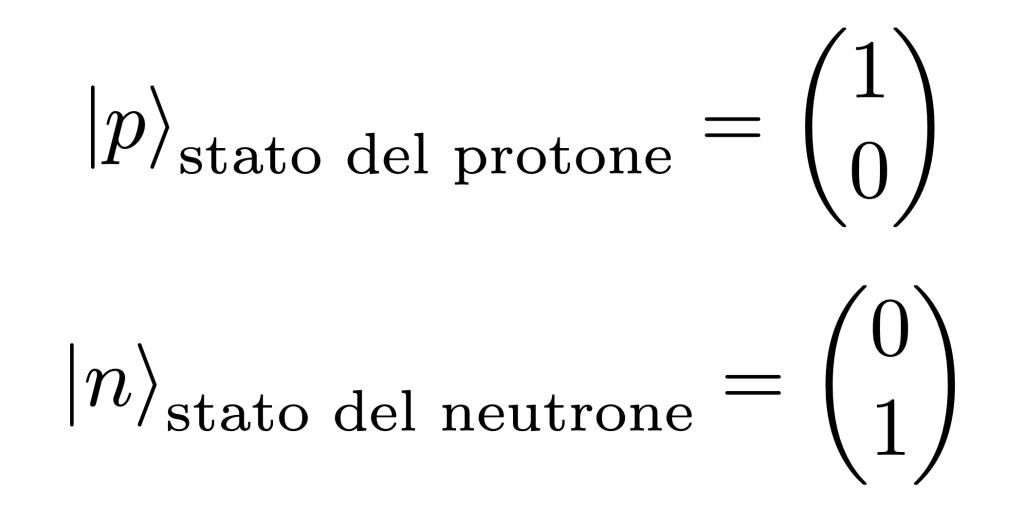

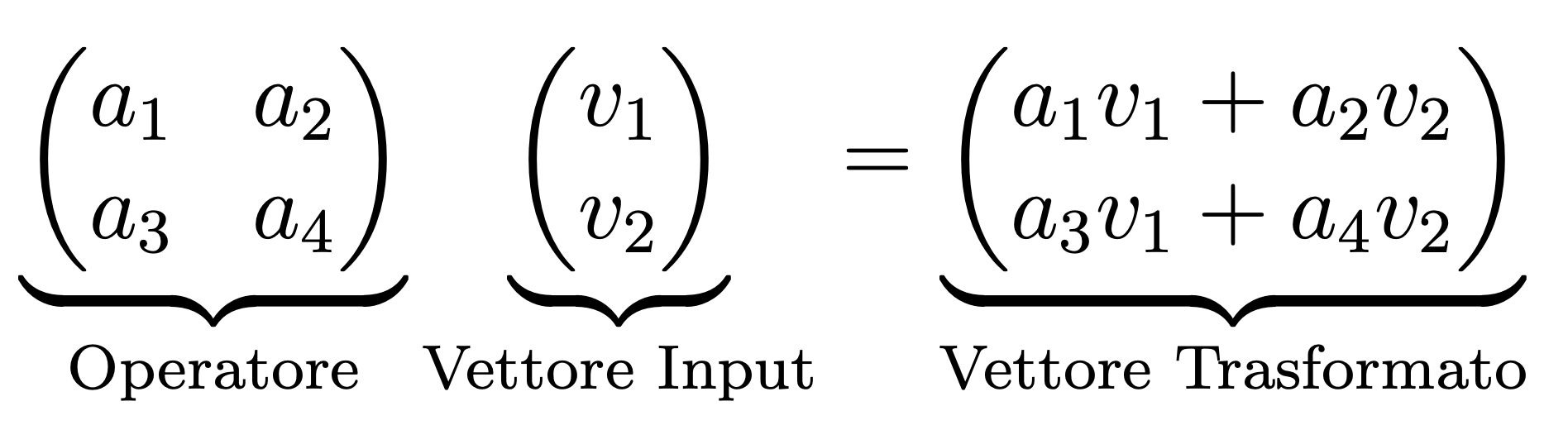

è chiamata, in gergo, “autovalore” dell’autostato. A ogni autostato viene associato il suo “autovalore”, il suo numerino personale da utilizzare come etichetta. Possono esserci anche più autostati aventi lo stesso autovalore, ma non vedrai due autovalori diversi associati allo stesso autostato.

è chiamata, in gergo, “autovalore” dell’autostato. A ogni autostato viene associato il suo “autovalore”, il suo numerino personale da utilizzare come etichetta. Possono esserci anche più autostati aventi lo stesso autovalore, ma non vedrai due autovalori diversi associati allo stesso autostato.

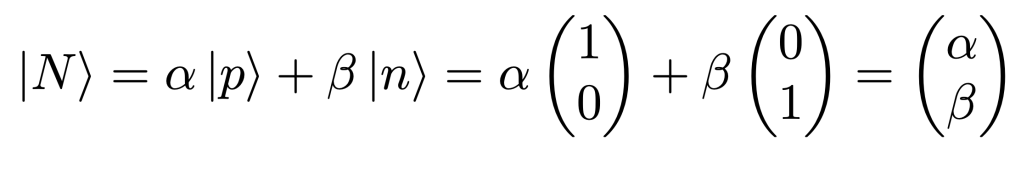

sono i pesi statistici, cioè il loro modulo al quadrato, ad esempio

sono i pesi statistici, cioè il loro modulo al quadrato, ad esempio  , rappresenta la probabilità che la particella, inizialmente nello stato generico “

, rappresenta la probabilità che la particella, inizialmente nello stato generico “ “, venga misurata in un ‘autostato

“, venga misurata in un ‘autostato  .

.

e

e  sono parametri costanti.

sono parametri costanti.

ci dà quindi informazioni sulla distribuzione delle configurazioni microscopiche del nostro gas.

ci dà quindi informazioni sulla distribuzione delle configurazioni microscopiche del nostro gas.

è la costante di Planck,

è la costante di Planck,  la massa delle particelle,

la massa delle particelle,  la costante di Boltzmann che converte da dimensioni di energia a dimensioni di temperatura tramite

la costante di Boltzmann che converte da dimensioni di energia a dimensioni di temperatura tramite  , e

, e  la temperatura del gas.

la temperatura del gas.

(o Eulero), l’energia

(o Eulero), l’energia  dello stato, la temperatura

dello stato, la temperatura  .

.

, e non più

, e non più  .

. .

.

e un nuovo sapore sterile (indicato in rosa). Notare come

e un nuovo sapore sterile (indicato in rosa). Notare come  .

.

“.

“.

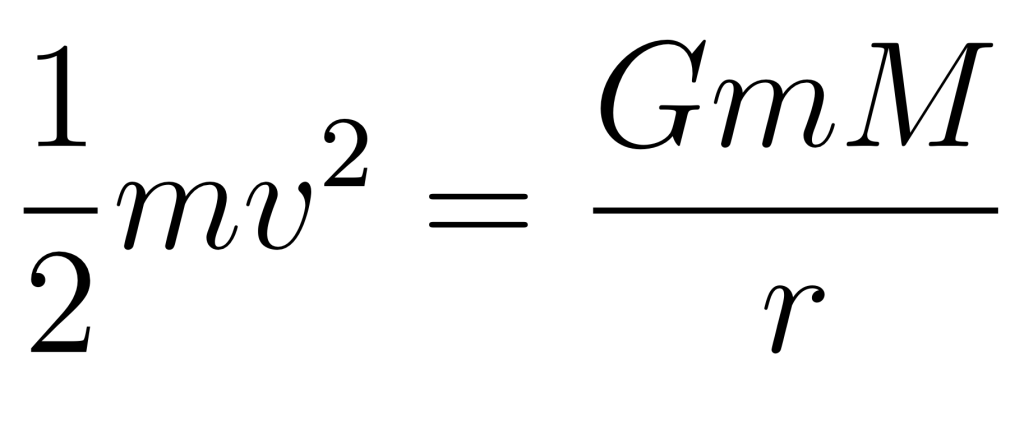

, otteniamo una relazione tra lunghezza e massa che dipende solamente da costanti fondamentali.

, otteniamo una relazione tra lunghezza e massa che dipende solamente da costanti fondamentali.

è ad esempio la frequenza di un fotone, la conversione tra frequenza ed energia è garantita dalla costante di Planck

è ad esempio la frequenza di un fotone, la conversione tra frequenza ed energia è garantita dalla costante di Planck

sono adimensionali, cioè sono dei numeri puri.

sono adimensionali, cioè sono dei numeri puri.

.

.

, mentre la curvatura è nulla nel punto

, mentre la curvatura è nulla nel punto  .

.